Sommaire

SEO technique : les points à vérifier sur votre site

Le SEO technique constitue la clé de voûte pour assurer la visibilité et la performance d’un site web dans les résultats de recherche. En 2026, dans un univers digital toujours plus compétitif, s’assurer que son site est optimisé techniquement est indispensable pour exploiter pleinement le potentiel de son contenu et de sa stratégie marketing. De la gestion du budget de crawl à l’amélioration de la vitesse de chargement, en passant par le maillage interne ou encore la conformité mobile, les facteurs techniques ne cessent d’évoluer et demandent une attention régulière. Cet article explique les points critiques à vérifier pour un SEO technique performant, et comment chacun de ces éléments participe à renforcer la présence web d’une entreprise, d’un blog ou d’une boutique en ligne.

En bref :

- Audit SEO technique : réalisation trimestrielle indispensable pour optimiser l’indexation et résoudre les erreurs 404.

- Structure des URL et fichiers robots.txt : fondamentaux pour une architecture claire et une communication optimale avec les moteurs de recherche.

- Performance et vitesse de chargement : impact direct sur l’expérience utilisateur et le positionnement dans les moteurs de recherche.

- Compatibilité mobile : un critère incontournable avec les dernières mises à jour de Google, qui privilégie désormais le mobile-first.

- Maillage interne et balises meta : leviers puissants pour guider l’exploration, répartir l’autorité et améliorer la pertinence des pages.

- Outils et méthodologies : utilisation de plateformes comme Google Search Console, Screaming Frog, ou Ahrefs pour diagnostiquer et corriger efficacement.

Optimiser l’architecture et l’indexation : les fondations indispensables

Le succès d’une stratégie SEO repose avant tout sur une architecture de site web bien pensée. Une structure claire facilite le travail des robots d’exploration et garantit que les pages les plus importantes bénéficient de la meilleure visibilité. Cela commence par la mise en place d’une organisation logique des contenus, depuis la page d’accueil jusqu’aux différentes catégories et sous-pages.

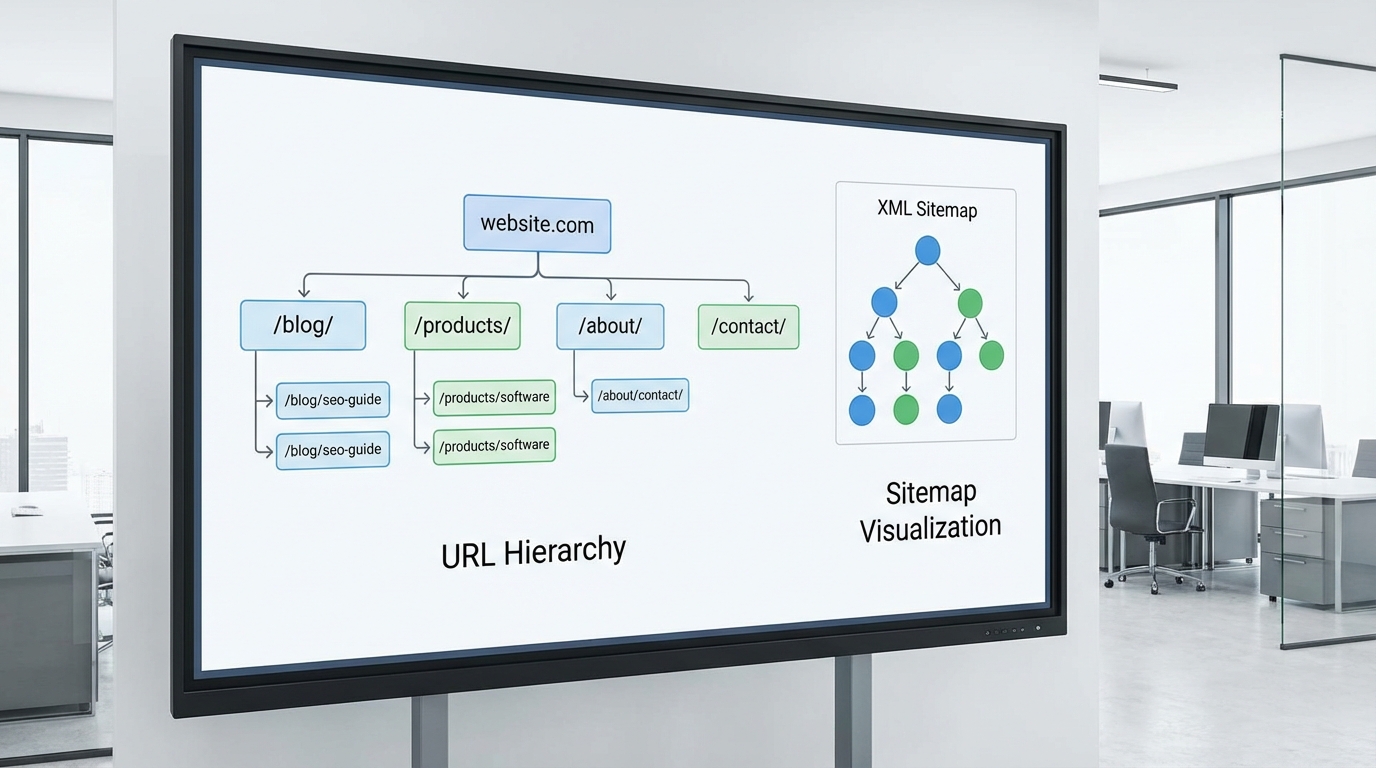

La structure des URL joue un rôle essentiel à ce stade. Les URLs doivent être à la fois courtes, compréhensibles et refléter la hiérarchie du site. Par exemple, une adresse comme exemple.com/produits/chaussures/running sera préférée à une URL trop longue ou ponctuée de paramètres incompréhensibles. Une bonne structuration évite la multiplication des versions d’une même page – comme les doublons causés par la présence ou non de la barre oblique finale – et facilite le référencement naturel.

Le fichier robots.txt est quant à lui le gardien de votre site, pilotant l’accès des robots des moteurs aux différentes parties de votre contenu. Une configuration inadaptée peut, sans que vous le sachiez, bloquer l’indexation de pages importantes. D’où l’importance d’un contrôle rigoureux régulier via des outils spécifiques comme le testeur intégré à Google Search Console.

Par ailleurs, la mise à jour et l’envoi du plan de site XML constituent une carte routière indispensable pour Google. Il permet au moteur d’anticiper les contenus clés à explorer et de repérer rapidement les nouvelles pages. Un sitemap mal configuré ou obsolète ralentit la prise en compte des modifications sur votre site et nuit à l’indexation globale.

En parallèle, la gestion des erreurs 404 nécessite une attention constante. Dès lors qu’un internaute ou un robot tombe sur une page introuvable, cela dégrade l’expérience utilisateur et amoindrit votre crédibilité auprès des moteurs. Il est donc crucial d’identifier ces URL cassées, de mettre en place des redirections 301 vers des contenus appropriés, ou de réparer les liens internes qui pointent vers ces pages obsolètes.

Un exemple concret illustre ce point : une boutique en ligne qui supprime un ancien produit sans redirection peut perdre tout le jus SEO acquis et pénaliser les pages liées. En assurant dès la suppression un renvoi vers une catégorie ou un produit similaire, la stratégie SEO technique conserve son efficacité.

L’analyse de la profondeur de clic garantit que vos pages clés ne sont pas trop enterrées dans la structure, ce qui pourrait limiter leur exploration et leur crawl par Google. L’outil Screaming Frog est idéal pour visualiser cette donnée et optimiser la hiérarchie de votre site.

Maillage interne et balises meta : optimiser l’exploration et la pertinence

Bien souvent sous-estimé, le maillage interne joue un rôle déterminant dans le référencement technique. Ce réseau de liens entre les pages permet de distribuer le « jus SEO », ou autorité, vers les ressources stratégiques. Un maillage pertinent améliore ainsi la circulation de la valeur SEO tout en guidant les visiteurs à travers l’écosystème du site.

Un maillage bien structuré doit inclure :

- Des liens clairs vers les pages importantes, notamment depuis les menus et pieds de page.

- Des ancres de texte descriptives évitant les expressions génériques comme « cliquez ici ».

- La suppression des chaînes de redirection pour éviter les pertes d’autorité.

- La correction des liens internes cassés, fréquents dans les gros sites avec beaucoup de contenu.

- L’évitement de la surabondance de liens sur une même page pour ne pas diluer la puissance du maillage.

Pour contrôler efficacement la qualité du maillage interne, des outils comme Screaming Frog ou Ahrefs permettent d’identifier rapidement les anomalies, notamment les pages orphelines ou les liens brisés.

Les balises meta complètent ce dispositif en fournissant aux moteurs de recherche des informations précises sur chaque page, telles que le titre, la description et les instructions d’indexation. Une absence ou un doublon dans l’utilisation de ces balises peuvent entraîner des problèmes d’indexation ou un affichage peu attractif dans les résultats de recherche.

Par exemple, une balise meta description unique et bien rédigée incitera davantage au clic, tandis qu’une mauvaise gestion des balises noindex pourrait empêcher l’indexation de pages cruciales. Il convient aussi de vérifier la présence correcte des balises canoniques afin de combattre le contenu dupliqué et de renforcer la pertinence.

Performance et vitesse de chargement : un impact direct sur le référencement

En 2026, la vitesse de chargement d’un site web reste un critère fondamental aux yeux de Google. Elle ne se contente plus d’influencer seulement l’expérience utilisateur mais est un facteur de positionnement SEO avéré. Les statistiques montrent qu’un délai de chargement supérieur à deux secondes fait fuir près de 50% des visiteurs sur mobile.

Les Core Web Vitals, introduits progressivement ces dernières années, mesurent précisément cette qualité perçue en combinant :

- LCP (Largest Contentful Paint) : la durée jusqu’au chargement du plus grand élément visible.

- INP (Interaction to Next Paint): la réactivité aux actions utilisateur, nouvelle métrique de référence.

- CLS (Cumulative Layout Shift) : la stabilité visuelle pour éviter toute frustration liée aux déplacements d’éléments pendant le chargement.

Pour améliorer ces indicateurs, divers moyens sont à privilégier :

- Optimiser les images en les compressant et en utilisant des formats modernes comme WebP.

- Mettre en place le lazy loading pour les contenus médias non visibles immédiatement.

- Minimiser et combiner les fichiers CSS et JavaScript.

- Utiliser un système de cache et un Content Delivery Network (CDN) efficace.

- Sélectionner un hébergement performant adapté à la charge du site.

Par ailleurs, un code propre et l’élimination des scripts inutiles évitent les lenteurs et contribuent à un affichage fluide. Pour surveiller la performance, il est conseillé de recourir à des outils comme Google PageSpeed Insights ou GTmetrix.

Une démarche complémentaire suppose également un audit régulier du code source pour éviter notamment les redirections mauvaises ou trop nombreuses, ainsi que les erreurs 404 qui peuvent dégrader la vitesse ressentie. Une correction systématique avec des redirections 301 judicieuses optimise le crawl et préserve l’autorité SEO.

Compatibilité mobile et sécurité : les piliers d’une expérience utilisateur optimale

Les moteurs de recherche ont définitivement basculé vers un mode d’indexation mobile-first. Cela signifie que la version mobile de votre site est désormais la référence principale pour évaluer la qualité et l’adéquation de vos pages.

Un site non compatible mobile risque de subir une pénalité sévère, perdant une partie importante de son trafic. Assurer une navigation fluide sur tous les écrans, avec un design responsive, des tailles de police adaptées et une disposition des menus lisible, est désormais incontournable.

Quelques bonnes pratiques pour une compatibilité maximale :

- S’assurer qu’aucun élément ne dépasse la largeur de l’écran pour ne pas forcer l’utilisateur à zoomer.

- Éviter les pop-ups intrusifs qui peuvent bloquer la navigation.

- Espacer suffisamment les boutons et liens cliquables pour faciliter l’interaction tactile.

- Tester régulièrement avec des outils comme le test d’optimisation mobile de Google ou Bing.

Sur le plan technique, la sécurité via le protocole HTTPS devient un standard non négociable. Le certificat SSL garantit la confidentialité des échanges, instaure la confiance avec les visiteurs et est intégré dans les critères de classement depuis plusieurs années. Il faut ainsi valider que toutes les pages chargent correctement en HTTPS et identifier rapidement tout contenu mixte (éléments HTTP sur page HTTPS), qui pourrait compromettre la sécurisation globale.

Une gestion cohérente des variantes d’URL (avec ou sans www, HTTP vs HTTPS) grâce à des redirections 301 correctes évite aussi les problématiques de contenu dupliqué et facilite l’indexation.

Audit continu et outils indispensables : la clé d’une optimisation pérenne

Le SEO technique ne peut être considéré comme une opération ponctuelle. Il s’agit d’un travail constant qui doit intégrer les nouvelles tendances, évolutions algorithmiques et changements sur le site. Un audit réalisé une fois par trimestre est recommandé pour maintenir la santé technique du site.

Les plateformes comme Google Search Console sont désormais incontournables pour suivre le statut d’indexation, détecter les erreurs 404, analyser les performances mobiles et surveiller les signaux essentiels de la vitesse.

D’autres outils spécialisés tels que Screaming Frog, Ahrefs ou Serpstat complètent ce dispositif en offrant des audits automatisés et des données exploitables rapidement.

Un tableau de suivi des points clé permet de piloter efficacement les actions à mener :

| Point clé | Outil / méthode | Objectif |

|---|---|---|

| Fichiers robots.txt | Google Search Console Testeur Robots.txt | Assurer une bonne exploration des pages |

| Plans de site XML | Google Search Console, Ahrefs | Faciliter l’indexation rapide |

| Erreurs 404 | Screaming Frog, GSC | Corriger les liens et rediriger proprement |

| Vitesse de chargement (Core Web Vitals) | PageSpeed Insights, GTmetrix | Optimiser l’expérience utilisateur et le SEO |

| Maillage interne | Ahrefs, Screaming Frog | Distribuer l’autorité et guider les visiteurs |

| Compatibilité mobile | Test d’optimisation mobile Google | Eviter les pénalités mobile-first |

| Balises meta | Audit manuel, outils SEO | Améliorer la pertinence et l’indexation |

Grâce à ce suivi, il devient plus facile d’intervenir rapidement dès qu’un problème technique apparaît, évitant ainsi des dégradations de visibilité souvent longues à corriger. L’expérience montre que les sites les mieux positionnés dans les moteurs sont ceux qui ont intégré cette routine rigoureuse.

À quelle fréquence faut-il réaliser un audit SEO technique ?

Pour un site web standard, un audit complet tous les trois mois est conseillé pour anticiper les problèmes. Toutefois, pour les sites plus grands ou avec publication fréquente, un suivi plus régulier est recommandé.

Comment corriger les erreurs 404 détectées ?

Il est impératif d’identifier l’origine de l’erreur et de mettre en place des redirections 301 vers des pages pertinentes ou de restaurer le contenu manquant afin de conserver la valeur SEO et offrir une bonne expérience utilisateur.

Quels outils sont recommandés pour analyser la vitesse de chargement ?

Google PageSpeed Insights, GTmetrix et Lighthouse sont parmi les plus populaires et précis pour diagnostiquer les problèmes de performance et guider les optimisations.

Comment assurer une bonne compatibilité mobile de son site ?

Utilisez un design responsive, testez régulièrement avec des outils spécialisés, évitez les pop-ups intrusifs et veillez à la lisibilité du contenu et à l’ergonomie des interfaces tactiles.

Quelle importance revêt le fichier robots.txt dans le SEO technique ?

Il guide les moteurs de recherche sur les zones à explorer ou non. Une mauvaise configuration peut bloquer des pages essentielles, nuisant gravement à votre référencement.